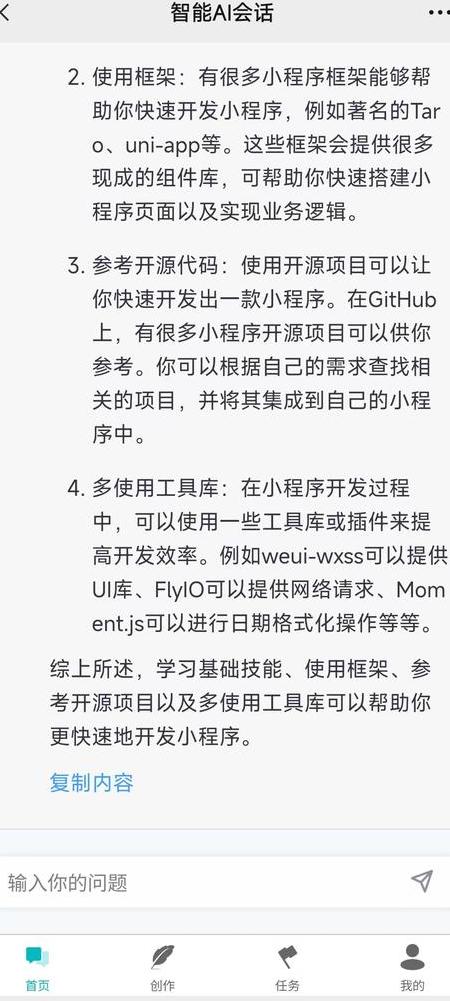

ChatGPT 回复中断仅给一半答案,原因竟然是这些

作为信息获取及疑惑解答的关键工具之一,ChatGPT在AI领域占据着重要地位。但在实际运用过程中,部分用户可能会遇到ChatGPT回复中断的情况,仅给出一半答案,令人费解且不安。本文将从学者角度出发,深度剖析此现象,并试图揭示其深层含义。

应用过程中,用户常遭遇ChatGPT仅提供部分答案的情况,这可能源于技术故障、算法制约或设计策略等多方面因素。首先,技术故障是最直接的原因,如服务器问题或软件漏洞引发回答中断。其次,算法制约亦不容忽视,鉴于ChatGPT的设计理念,其在应对复杂或敏感问题时,为防止输出错误或不当信息,可能会自动停止响应。

除此之外,“半句话”现象亦有可能作为一项构思巧妙的设计策略而存在。在这一思路下,开发者或许精心策划,希望以此模拟人类思维模式,为使用者提供更为人性化的交互体验。如此一来,ChatGPT便不仅仅是解答疑问的工具,更是能激发用户思考与交流的伙伴。然而,此类设计同样面临着挑战,即如何在确保用户体验的基础上,防止因信息缺失导致的误解及困扰,成为了开发团队需认真面对并解决之难题。

在使用ChatGPT时,用户的反馈各有差异。部分使用者因需求期望完整回答从而心生挫败和疑惑,可能转而重提问题或寻求他处援助。然而,另一部分用户却能从这种不完全信息中激发好奇心,自行探索以弥补不足。这样的反应呈现出用户对信息依赖的同时,也展现出其应对未知情境的多样化策略。

此外,此类”半句话”现象可能降低用户对ChatGPT的信任度。倘若用户频繁遭遇信息不全的困扰,他们有理由质疑ChatGPT的可靠与精确。故而,如何在产品设计中权衡信息的完整性及用户心理感受,成为了提高用户满意度的关键问题。同时,此现象警醒我们,倚赖AI的同时,保持批判性思考和独立判断力的重要性不应忽略。

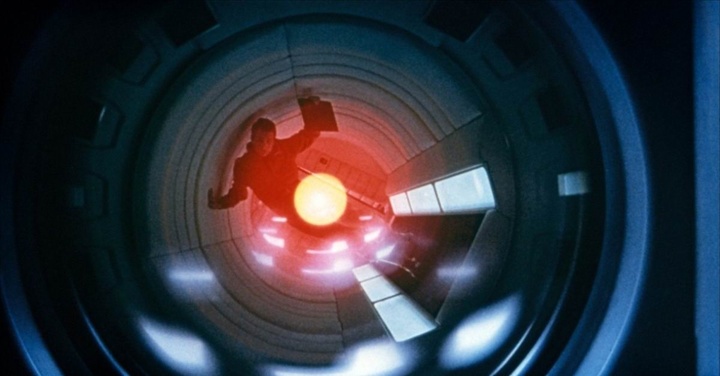

ChatGPT的”半句话”现象不仅是技术问题,更引发了对深层哲学的思辨。AI作为人类思维仿真器,其所生成的不完善信息是否映射出人类思维的不确定和复杂性?面对这种不完善,我们应如何看待并接纳其为与AI互动的一部分?此类问题促使人们反思人工智能与人的关系,以及在这一关系中所扮演的角色和承担的责任。

在此基础上,信息及知识的不完备性引发了有关理论探讨。一直以来,人们都将两者看作完整而确切之物。然而,ChatGPT的“半句式回答”却对此提出质疑,揭示出信息与知识本就存在不完全且不确凿的特性。此观点转变了人们对于信息的认知,并有望洗牌我们对知识的理解以及衡量标准。

针对ChatGPT存在的”半句”问题,不仅要从科技角度寻求改善,更需从社会与文化层面进行调整。技术研发团队应持续优化算法,提升信息的全面性及精确度。同时,使用者亦需培养更为开放且灵活的信息处理技巧,学会在不确定性和不完全性中发掘价值和意义。

决策者与教育工作者在塑造人工智能运用的公共观念及培养大众批判性思考与创新能力方面具有关键作用。通过实施相关政策与教育战略,我们有望实现一个人工智能应用更为智能化、透明化且更具人性关怀的未来。

ChatGPT的「半句」问题,不仅是技术上的挑战,而且深刻反映了哲学与文化层面的议题。它警示我们,在追求知识和信息时,必须学会接纳并理解其不确定性及不完全性。深度剖析此现象,有助于我们更有效地运用人工智能,同时也能推动个人思维的发展和提升。

敬读之余,谨向读者提问:当面临ChatGPT提供的不当信息时,您将如何应对?对于此类信息的缺失,您有何高见?期待您在评论区分享观点,共同探讨此一颇具挑战性的议题。若本文对您有所启示,恳请您慷慨点赞与分享,以吸引更多同仁加入讨论。