GPT人工智能运作原理详解:Transformer架构与大规模语料训练

GPT是人工智能领域的一颗耀眼明星,备受瞩目。其运作机制充满探究价值,与传统程序有着显著差异chatgpt原理Ai写作,背后依托的是一套复杂且独特的技术体系。下面,我将详细为大家讲解其运作原理。

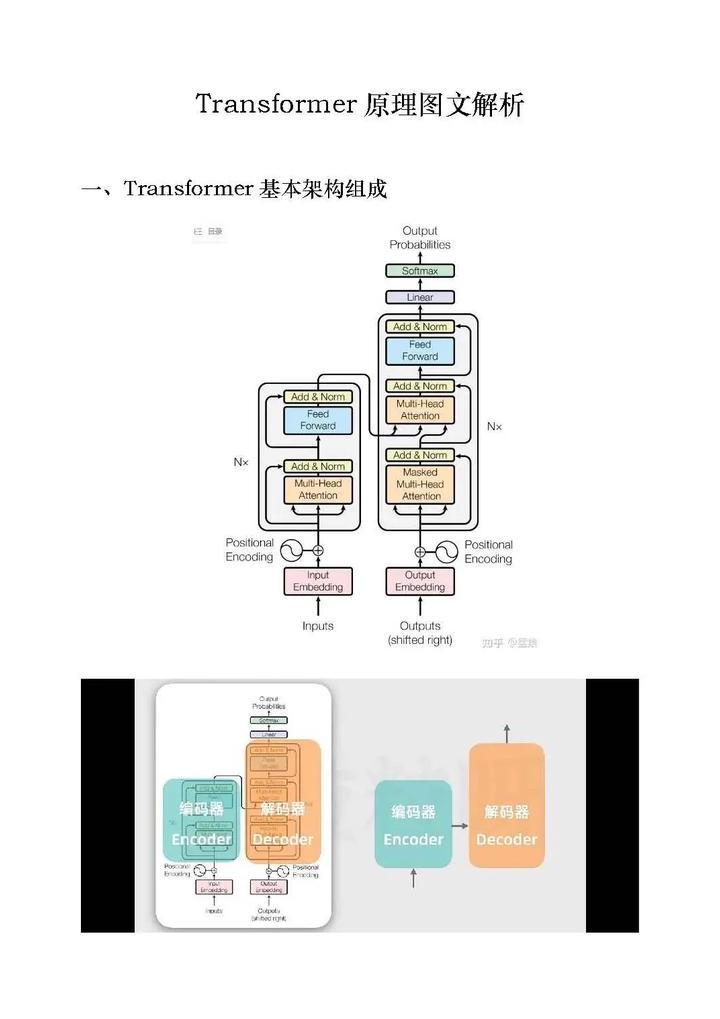

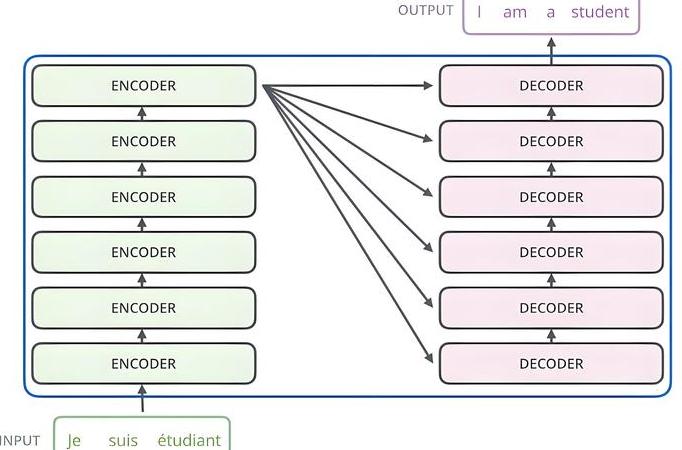

神经网络架构

GPT使用了Transformer这一强大的模型架构。它如同一位技艺高超的工匠chatgpt原理,能够细致地关注文本中的各个部分,并恰当地分配注意力。在分析句子时Ai智能写作助手,GPT能够捕捉到每个词汇与其他词汇之间的联系,为生成恰当的回答打下基础。这种架构既灵活又高效,远胜于传统的循环神经网络。

大规模语料训练

为了使GPT更聪明,开发者采用了大量的文本资料进行训练。这些资料涵盖了网络上的众多文章、书籍、交谈等。在持续的学习过程中,GPT能够领悟人类语言的规则,熟悉各种词汇的内涵及用法。这就像一个学生通过不断学习,增强自己的本领。

预测下一词

GPT在运作中,其核心职责是预测后续可能出现的词汇。它依据输入的文本内容免费ChatGPT中文版,结合自身训练所得的知识,对文本进行解析并挑选出最有可能的词汇。这一过程会持续进行,直至形成完整的句子或段落。这就像我们在交谈中,一边思考一边表达,逐步传达出完整的想法。

人工反馈调整

自动训练之外,人的评价同样关键。开发者会邀请专家对GPT的回答进行评分和修改。依据这些人工评价,对模型进行调整和提升,让生成的答案更加精确,更贴近人的需求,这就像老师辅导学生不断进步一样。

大家对GPT的工作机制还有什么不清楚的地方吗?欢迎在评论区提出,如果觉得内容不错,别忘了点赞和转发!